En los últimos años, hemos experimentado la transformación de nuestro teléfono móvil en cámara de fotos, en un proceso en el que la mayoría puede considerarse protagonista de la conversión. ¿Quién no usa su teléfono como cámara principal? Es obvio, siempre los llevamos encima y la calidad que podemos conseguir es fantástica sin tener que ser expertos en la materia.

La tecnología ha avanzado demasiado rápido, en un espacio tan reducido los ingenieros están integrando sistemas capaces de registrar fotos y vídeos de una calidad que poco tienen que envidiar a equipos profesionales. El principal damnificado de toda esta situación es la pequeña cámara compacta, que casi ha dejado de tener sentido.

Las cámaras de un nivel superior, o profesionales, respiran todavía tranquilas, ya que actualmente los teléfonos no pueden competir contra la combinación de objetivos y sus sensores más grandes. El problema para ellas aparece cuando la fotografía computacional entra en escena: inteligencia artificial y diferentes cámaras en un mismo dispositivo.

La flexibilidad que permiten las entrañas de un teléfono móvil difícilmente se va a conseguir con una cámara “convencional”. Su naturaleza es la de un dispositivo conectado, que no para de recibir aplicaciones y mejoras, al tiempo que es un monstruo en potencia gráfica que podemos llevar siempre en el bolsillo. La potencia de proceso es vital si se quiere dominar la nueva fotografía computacional.

Nos tenemos que remontar a 2010 para empezar a conocer teléfonos que introducían el concepto HDR en la toma de fotografías. El proceso de tomar una instantánea con “alto rango dinámico” es tedioso: resumiendo mucho, hay que tomar varias fotos con diferentes parámetros y unirlas. Todo eso lo empezaba a hacer un teléfono de forma instantánea, en una única pulsación.

HDR es una técnica software que nos abrió los ojos, pero solo un simple ejemplo de lo que estaba por llegar en próximos años: mejoras en el zoom, capacidad para realizar tomas en niveles de oscuridad impensables para sensores tan pequeños, o retratos con desenfoque a un nivel impresionante.

La inteligencia artificial demanda más cámaras

Desde el punto de vista del hardware, el gran cambio llegó con la introducción de diferentes cámaras en el mismo teléfono, hablamos de 2014. Pero podemos considerar al Huawei P9 (2016) como la primera herramienta real capaz de aprovechar dos cámaras: una en blanco y negro y otra en color. Su funcionamiento se basaba en capturar diferentes aspectos de una misma escena para luego combinarlos con la potencia e inteligencia que el teléfono es capaz de desarrollar.

El estado del arte de esta tendencia hardware la estamos viviendo con el Huawei P20 Pro y sus tres cámaras. Ningún otro teléfono de gama alta se ha atrevido a conjugar tanta información desde cámaras diferentes, algo que es posible gracias al hardware dedicado a inteligencia artificialdesarrollado por la casa – Neural Processing Unit -, además de la potencia de proceso del procesador Kirin 970.

El futuro se torna fascinante con la posibilidad de que pronto sean capaces de seguir mejorando el desarrollo de las múltiples cámaras.

No solo se trata de hacer un procesado de lo capturado, como os presentamos en este artículo. Los teléfonos tienen la capacidad de reconocer elementos y situaciones, eso hace que automáticamente puedan adaptar los parámetros para conseguir las mejores condiciones, sin que el usuario tenga que saber realmente qué está ocurriendo. En definitiva, la IA ha llegado para ayudarnos a conseguir mejores fotos.

El futuro de la fotografía está en la inteligencia artificial, es una realidad que se está construyendo día a día, por lo que no hay que esperar a ninguna revolución. Los argumentos ya están sobre la mesa y, a continuación, vamos a conocer algunos ejemplos.

La IA y el poder del retrato

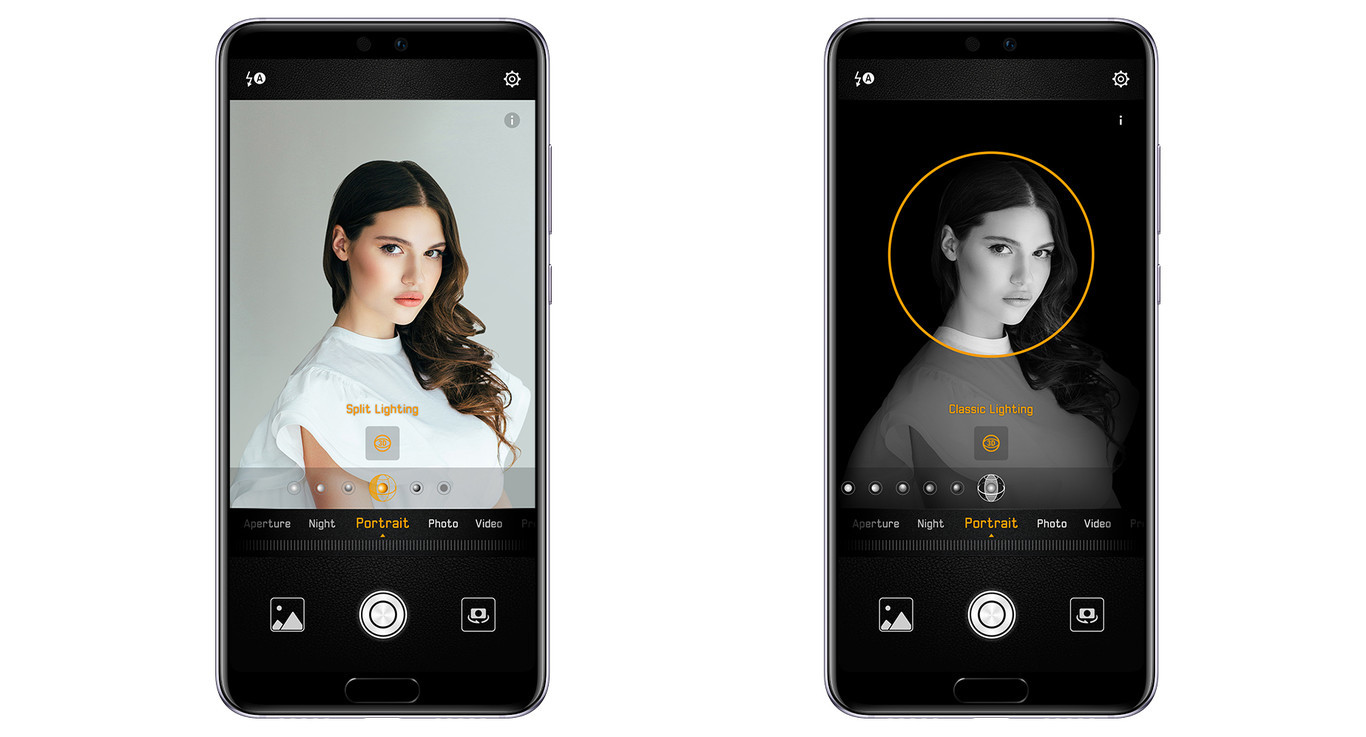

Posiblemente sea el ejemplo más claro para el usuario de un smartphone actual: el retrato con desenfoque. La inversión que hay que hacer en un equipo profesional para hacer retratos de calidad es bastante alta, mientras que con un teléfono podemos conseguir resultados llamativos por mucho menos. De nuevo tenemos que dar las gracias a la fotografía computacional.

Partimos de la idea de que con dos cámaras trabajando al mismo tiempo podemos registrar cierto nivel de profundidad en la escena. Lo siguiente sería reconocer los elementos que participan para aislar con calidad al sujeto del escenario. Lo habitual en este proceso es pasar a suavizar el fondo para conseguir el deseado efecto bokeh, algo que se puede hacer con mayor definición si nuestro sistema ha interpretado bien todos los puntos anteriores.

Aunque suene complicado, también es posible realizar el “retrato digital” con una única cámara, y será gracias a la inteligencia artificial: el aprendizaje máquina es capaz de reconocer y seleccionar elementos para aislarlos y trabajar con ellos. Lo bueno es que todo esto se puede transportar fácilmente a la cámara frontal de los teléfonos para conseguir selfies todavía más potentes.

Zoom y mejora

Hay otros muchos ejemplos de algoritmos que están revolucionando la forma en la que fotografiamos. El simple hecho de realizar un zoom o aumento de la imagen puede llevarnos a perder mucha calidad. Las cámaras de nuestros teléfonos suelen contar con ópticas fijas y todo lo que sea trabajar la imagen de forma digital conlleva distorsionar bastante la imagen. Aquí también puede entrar en juego el entrenamiento que ha realizado el sistema de inteligencia artificial, interpretando y arreglando el resultado.

En este punto también entra en juego la posibilidad de que haya varias cámaras, ya que cada una de ellas tendrá una focal distinta. Es posible ganar calidad de imagen en un zoom si se tiene en cuenta la información que registran las diferentes ópticas, en la suma de estos datos también está muy involucrada la inteligencia artificial.

Es pronto para conseguir mejorar de forma importante la resolución de las imágenes, pero ya es posible hacerlo con sistemas como Let’s Enhance, que escalan una foto en cuatro veces su tamaño sin perder calidad. De nuevo hablamos de algoritmos de inteligencia artificial (CNN). En un futuro próximo este proceso se realizará desde el propio dispositivo.

Aprendiendo a ver en la oscuridad

Si disparas una foto en condiciones de poca luz, es necesaria una exposición más larga para que las cosas se vean bien. También condiciona el hecho de que todo esté bastante quieto: tanto la cámara como los elementos a fotografiar.

La inteligencia artificial también está ayudando a trabajar con este tipo de sensibilidad tan complicada a la luz. Podemos ver el trabajo al respecto de los investigadores de la Universidad de Illinois en el siguiente vídeo:

Prediciendo movimientos

Si nuestra cámara es capaz de predecir hacia qué lugar se mueven los elementos o qué cambios se van a producir en la escena, podrá adaptarse y crecerán las posibilidades de conseguir una mejor toma. A nivel de mercado, es algo que fabricantes como Huawei ya han introducido, como en el modelo P20 Pro.

El sistema ,llamado ‘4D predictive focus’, mezcla inteligencia artificial con el uso de un sensor láser que mejora la velocidad de enfoque con objetos que estén a menos de tres metros de distancia.

Un asistente inteligente

Mantener el control y registro de todas las fotos que hacemos es cada día más complicado. Lo normal es que no tengamos tiempo para estar encima de esta organización, a menos que sea parte de nuestro trabajo. La inteligencia artificial puede categorizar las fotos por nosotros, ordenarlas bajo criterios, además de mejorarlas, como hemos visto en los puntos anteriores.

Esta idea se puede implementar en teléfonos móviles. De hecho, las galerías de los sistemas operativos son cada vez más sensibles a informaciones como la localización o el tiempo en que fue tomada.

Un paso más allá es posible si se cuenta con asistencia a la hora de realizar las imágenes. Hay muchos fotógrafos que no quieren que la imagen se capture de forma completamente automática, pero sí agradecerían una asistencia en los principales parámetros.

Podemos encontrar algo así materializado en un dispositivo como Arsenal, un accesorio para cámaras que nos ayuda a tomar la mejor instantánea teniendo en cuenta miles de imágenes que fueron realizadas en ese mismo lugar.

Captura la vida diaria

Imaginad que la actividad de realizar fotografías pasa de ser un acto consciente y se empieza a delegar en un sistema inteligente. Google ya nos ha anticipado esto con Clips, una cámara que toma todo el potencial de la inteligencia artificial y lo lleva a otro nivel.

Resumiendo mucho la idea, tenemos que saber que contaremos con una cámara que debemos situar en el campo de acción que queremos cubrir. Las cosas importantes que allí ocurran y el reconocimiento de los personajes corren de su cuenta. Automáticamente mandará fotos y vídeos a nuestro teléfono para que allí podamos editar y compartir si así lo consideramos oportuno.

La inteligencia artificial ha llegado para quedarse

Desde hace 180 años, la fotografía ha ido evolucionando, pero la relación entre la cámara y el usuario no ha cambiando tanto como pueda parecer: disparar y registrar la imagen, inicialmente en formato químico, más adelante en digital.

La inteligencia artificial ha llegado para cambiar las reglas del juego, ayudándonos a conseguir mejores resultados en todo el proceso: antes, durante y después de disparar. Afortunadamente esto no ha hecho más que comenzar.

Imágenes / Huawey y Unsplash