¿Alguna vez habéis leído un libro de hace décadas, anterior a vuestra generación? Los seres humanos tenemos, gracias a la lectura o el vídeo, la capacidad de aprender de alguien que ni siquiera está con nosotros. También de aprender del compañero sentado al lado. Por el contrario, memorizar no se nos da tan bien.

Las máquinas copian información (memorizan) a velocidad de vértigo, en eso nos ganan, pero la inteligencia artificial aún no sabe transferir inteligencia. Una IA que conduzca no podrá aprender de la experiencia de un único conductor. Nosotros, sí. ¿Cómo de cerca está el machine learning de algo así?

¿Qué es exactamente el ‘machine learning’?

El machine learning es una técnica, o conjunto de ellas, que permite a una máquina aprender de un gran volumen de datos y una serie de reglas. Los humanos podemos aprender con un único caso –a veces también ayudados por la IA–, como por ejemplo cuando nos dicen por primera vez “mentir está mal”. Aunque sigamos haciéndolo, nos queda claro: lo hemos aprendido.

Sin embargo, una IA tendría que decir muchas falsedades y verdades, identificarlas como tales, y luego recibir la instrucción “no se puede decir algo que sea falso”. Después de este proceso, que puede requerir miles o cientos de miles de frases correctas o incorrectas, podemos decir que la IA “sabe” qué se puede decir o qué no. Ha aprendido.

Qué es transferir inteligencia, según los expertos

Demis Hassabis es un diseñador de videojuegos que investiga la inteligencia artificial y, a la vez, es neurocientífico. Los últimos descubrimientos en IA se han producido gracias a que cada vez comprendemos mejor cómo funciona el cerebro, por lo que Hassabis es la persona perfecta para respondernos qué es transferir aprendizaje y si llegaremos a lograrlo algún día:

En el vídeo, Hassabis comenta que “transferir aprendizaje consiste en conseguir llevar conocimiento de un dominio a otro”. Un ejemplo muy abstracto podría ser la mejor comprensión de una cultura porque estamos aprendiendo a hablar y escribir su lenguaje, algo en lo que la inteligencia artificial está haciendo sus pinitos.

Ahora bien, transferir aprendizaje no es transferir inteligencia, aunque sí están relacionados en su base. Se sospecha que los humanos somos “tan” inteligentes porque hemos sido capaces de escapar de la realidad para formar conocimiento abstracto, como las matemáticas, que lo mismo sirven para la estadística de las ciencias sociales como para realizar cálculos químicos.

Parece que abstraerse usando “moldes mentales” es una buena estrategia para lograr una IA inteligente, y también que todo aparezca con problemas similares y relacionados. O copias de problemas parecidos. Lo que nos lleva a la pregunta: ¿Podría una IA copiarse y resolver una segunda tarea?

Una máquina puede copiar su “cerebro”…

Una habilidad que no tenemos los humanos es duplicar nuestro cerebro. Las máquinas ya nos han superado en muchas habilidades, y otras son enteramente suyas. Ellas sí pueden duplicarse. Uno puede trabajar con una inteligencia artificial basada en el lenguaje natural, como por ejemplo un chatbot, y copiarlo. Así, podríamos incluso ponerles a hablar entre ellos, y a discutir.

En 2011, el Laboratorio de Máquinas Creativas de la Universidad de Cornell hizo un experimento similar basando el “cerebro” de ambas partes en la máquina Cleverbot, y consiguiendo con ello una conversación del todo absurda. En 2018, debido a la complejidad que tiene el lenguaje, no estamos mucho más avanzados, y sin embargo hemos conseguido logros como Hans o Sophia.

En el vídeo se observa un “partido de tenis” lingüístico. Ninguna de las dos IA tiene ni idea de lo que está diciendo, solo responde a la otra. Tampoco aprenden entre ellas. Para que cualquiera de ellas pudiese transferir conocimiento, tendrían que hablar durante muchas horas seguidas de un tema muy concreto, repitiendo una y otra vez datos similares.

Así es como aprende el software de Microsoft que ayuda a realizar traducciones en tiempo real y sin WiFi en dispositivos como el Huawei P20. En este caso, Microsoft se sirve de millones de casos particulares para construir conocimiento. No aprende de una conversación, sino de comparar miles entre sí.

A pesar de la apariencia absurda del experimento de arriba, lo cierto es que copiar una IA nos ha permitido seguir aprendiendo. El experimento de Facebook en 2017 para crear una red generativa adversaria ayudó a mejorar el software de negociación. Y las IA se han mostrado tan creativas que nos cuesta saber si el cuadro lo pintó una máquina o un humano.

…y transferir parte de su ‘know-how’

Pero, ¿qué ocurriría si una inteligencia artificial pudiese llevarse parte del conocimiento que tiene sobre una tara para realizar otra diferente? Lo cierto es que esto es posible desde principios de 2017. DeepMind, la IA de Google (Alphabet), usó una herramienta nueva para mejorar su aprendizaje automático. El mecanismo, llamado Consolidación de Peso Elástico (EWC por sus siglas en inglés), ayudó a esta IA a jugar a varios juegos de Atari. Y a ganar, claro.

Pero, ¿cómo funciona ? Intentemos verlo con un caso muy sencillo: las damas y el ajedrez. Ambos juegos son parecidos: el tablero es idéntico y las piezas tienen movimientos similares. Aunque el objetivo y mecánica es diferente, es más fácil aprender a jugar al ajedrez si ya sabemos jugar a las damas. A la IA se le dan bien los juegos por ser repetitivos.

¿Significa que la inteligencia artificial ya está “subida a hombros de gigantes”? No es el caso. Los humanos consolidamos conocimiento, inteligencia, e incluso sabiduría, a lo largo de generaciones. La IA, no. Usando el EWC, una máquina puede aprender hoy a jugar a las damas y mañana al ajedrez, pero en ese momento habrá olvidado por completo cómo se juega a las damas.

¿Máquinas aprendiendo de otras máquinas?

Cuando dos IA se enfrentan, surgen aspectos interesantes: conversaciones, técnicas de negociación, e incluso cierto atisbo de creatividad. Además, el EWC parece una buena herramienta a la hora de transferir buena parte de la inteligencia.

Las personas también nos enfrentamos entre nosotros para aprender. En la escuela hay varios tipos de competitividad: la que tenemos con nuestros compañeros y la que llevamos contra nosotros mismos, tratando de mejorar. Marcas como Huawei buscan digitalizar primero y hacer inteligentes después los entornos educativos. Y esto es clave en la investigación del futuro.

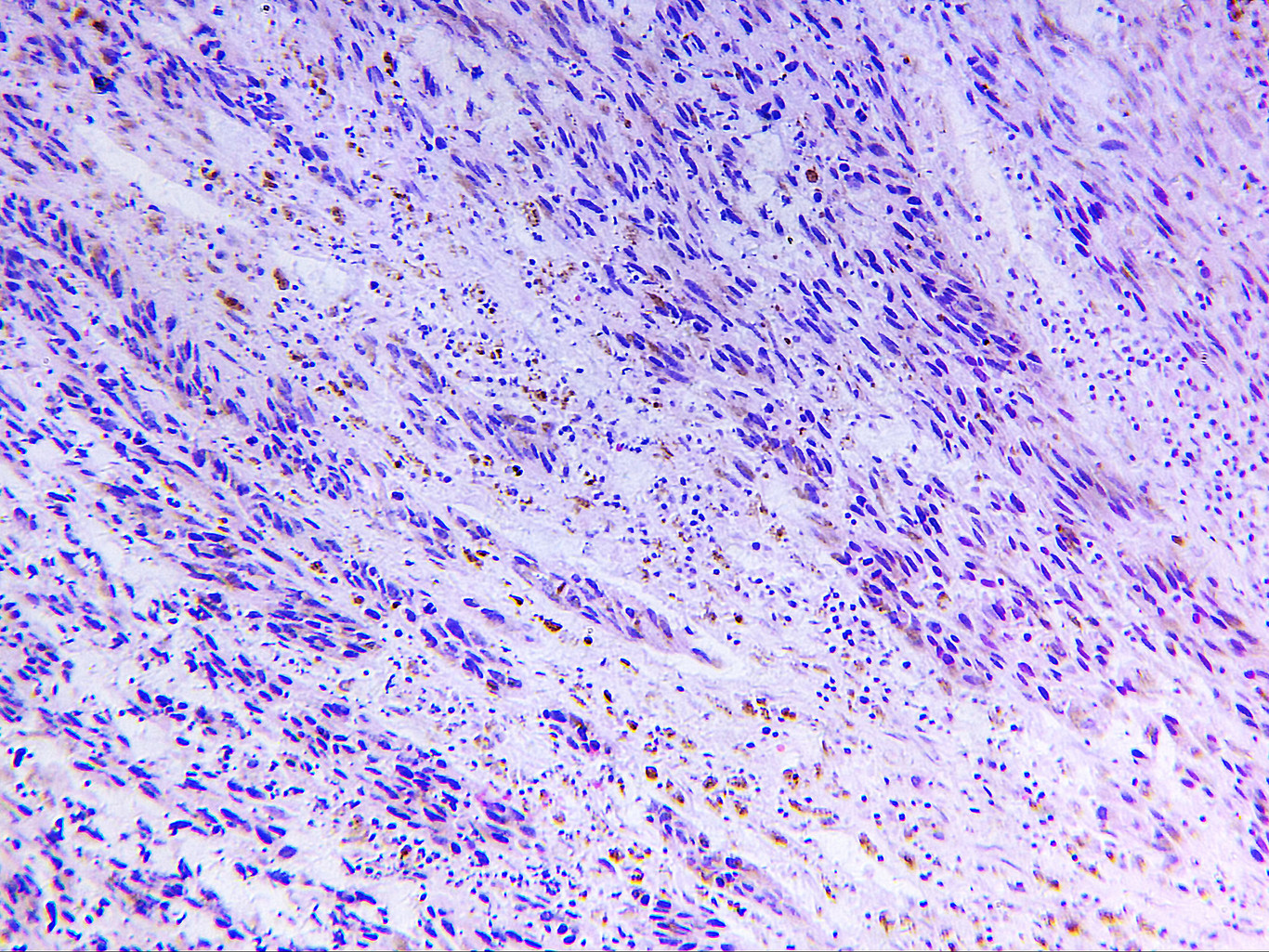

Veamos otro ejemplo. Varios equipos de investigación de la Universidad de Stanford diseñaron un algoritmo que pretende detectar cáncer de piel mejor que los propios dermatólogos. Para ello, usó 129.450 imágenes. La IA requiere de un enorme volumen de información para aprender mediante machine learning.

El experimento demostró que la inteligencia artificial tenía éxito a la hora de clasificar enfermedades simplemente mirando imágenes, una aplicación de la IA que quizá nos haga vivir más años. Ahora bien, ¿puede usarse la misma IA para detectar tumores en pulmones? ¿O arritmias escuchando pulsos del corazón?

Sin modificaciones, no. Pero es posible que, usando herramientas de EWC, unido a miles de imágenes clasificadas de pulmones o electrocardiogramas, una segunda IA aprenda de una forma mucho más rápida que si no hubiese tenido como punto de partida la anterior. Se podrán dar varios escenarios:

- aprender en menos tiempo con un error similar

- aprender con menos datos con un error similar

- reducir el error usando el mismo tiempo y/o datos

Cualquiera de las posibilidades son una buena noticia a nivel médico. No se ha transferido inteligencia, pero se ha acercado o mejorado el logro de conocimiento. Y ese es un buen uso de la inteligencia, sea o no artificial.

Imágenes | iStock/djvstock, iStock/Kirillm, Paul Brennan, iStock/viach80